AI深度偽造 換臉變聲詐騙

【記者 楊澤恩/綜合報導】

科技日新月異,「深度偽造技術」(Deepfake)成為不法分子的工具,利用「深度偽造技術」製造假新聞、假圖像、假影片,製造社會恐慌,詐騙牟利,大眾需小心謹慎,避免落入陷阱。

人工智慧發展 科技製圖真假難辨

在科技日新月異的現代,人工智慧技術突飛猛進,演變出「深度偽造技術」(Deepfake),原文 Deepfake 源自於英文「deep learning」和「fake」組合,即為以深度學習進行偽造。主要是以人工智慧深度學習的技術,合成偽造圖像、影片或聲音,可以真人偽造影像或憑空創造虛假影像。最常見於提升「深度偽造技術」的做法為「生成對抗網路」,會包含「生成器」和「辨識器」這兩組神經網路。經過投餵大量資料,「生成器」和「辨識器」會不斷重複生成偽造及辨認評分影像,在這個不斷進行機器學習的過程中,偽造及辨識偽造的技術會不斷進化,形成更擬真且更難以肉眼分辨的影像,到最後需依靠電腦計算辨認是否為真實影像。

This Person Does Not Exist 網站上利用「生成對抗網路」創造出來的虛假影像,並不是以真人偽造,目前已難以肉眼辨認。【記者 楊澤恩/翻拍自 This Person Does Not Exist】

This Person Does Not Exist 網站上利用「生成對抗網路」創造出來的虛假影像,並不是以真人偽造,目前已難以肉眼辨認。【記者 楊澤恩/翻拍自 This Person Does Not Exist】

不實資訊廣傳 深度偽造亂象多

因「深度偽造技術」的普及,目前在網路社交媒體充斥各類以「深度偽造技術」製作的內容。以轟動全台的小玉事件為例,以明星、藝人、網紅、政治人物等公眾人物的臉部移植合成情色影片,以此招攬網友付費瀏覽。

國立中正大學中文系黃同學表示,在網路上有看過以「深度偽造技術」製作的假信息,多數是以蔡英文和其他名人的肖像偽造,捏造假信息。目前網路上已隨處可見利用「深度偽造技術」製作的影片,不法者會透過製造情色影片以此牟利。甚至偽造蔡英文、張忠謀、馬斯克等名人肖像及透過更改嘴型及演講內容遊說民眾投資,以此欺詐。

以「深度偽造技術」偽造賴清德、蔡英文的演講內容,騙取民眾投資。【記者 楊澤恩/翻拍自臉書的虛假廣告】

以「深度偽造技術」偽造賴清德、蔡英文的演講內容,騙取民眾投資。【記者 楊澤恩/翻拍自臉書的虛假廣告】

簡易辨別真偽 民眾可採四大技巧

國立中正大學經濟系李同學表示,自己在網路上看過疑是以「深度偽造技術」製作的影片,自己會透過聲音及說話方式來判斷,但通常很難以肉眼判斷真偽。目前社交媒體上的深偽影片仍有破綻在,沒有有效偵測技術的情況下,民眾可利用四大技巧來判斷,避免受騙。民眾可關注影片裡背景區域是否模糊,注意人臉區塊是否閃爍、臉部輪廓是否自然,注意眼睛瞳孔是否不規則以及注意嘴型、表情與聲音是否吻合。

以《基於少量訓練樣本下之深偽視訊鑑識技術》中研究表示偽造技術推陳出新,目前的偽造偵測技術在針對沒見過的偽造手法就有可能失效,無法辨識真偽。研究中使用的偽造偵測技術可達到平均80%的準確度,透過電腦的方式也沒辦法百分百的確認真偽。

小心技術成雙面刃 接收資訊需謹慎

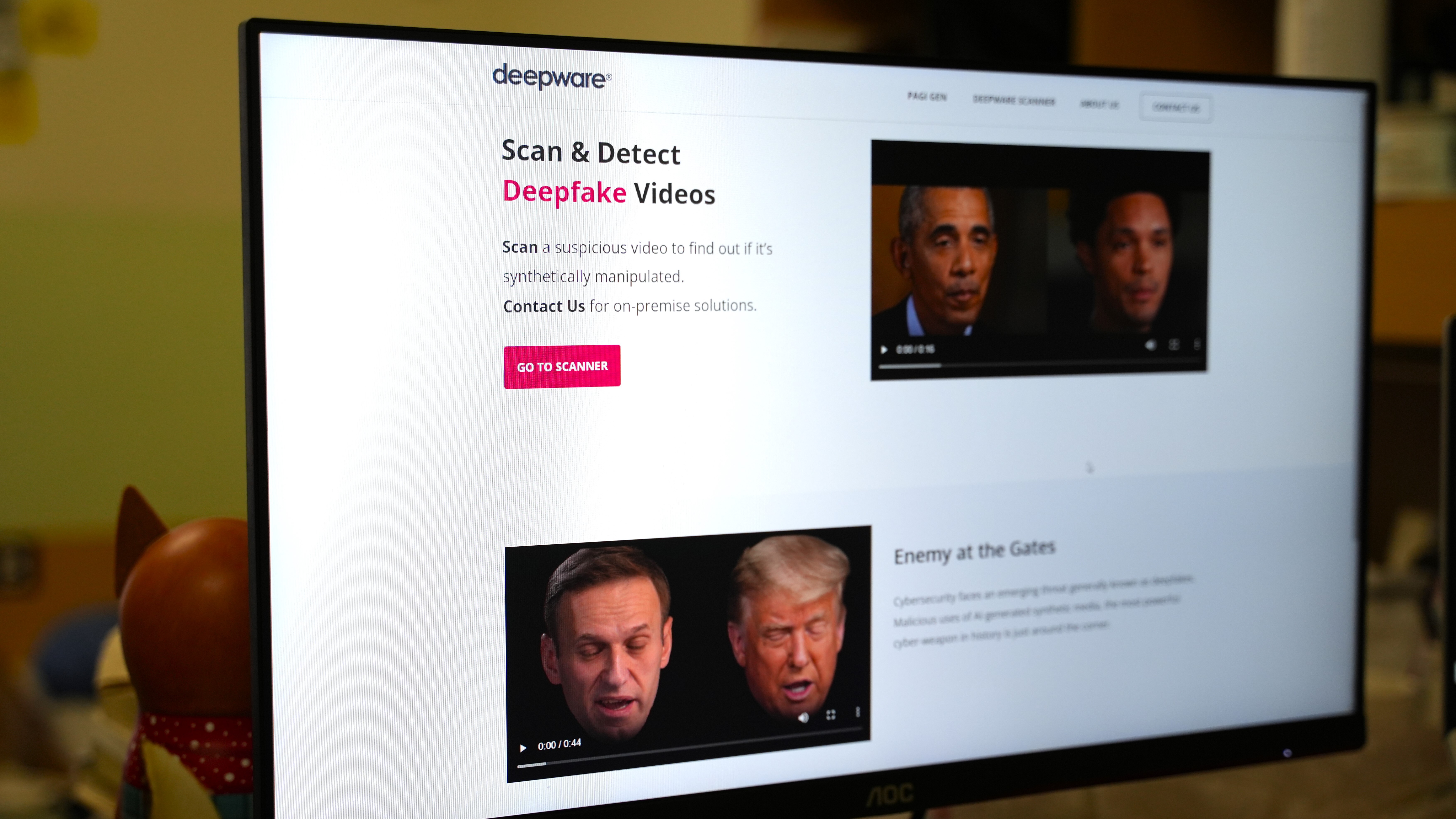

「深度偽造技術」的運用飛速發展,在電影、遊戲等藝術產業中可令製作更省時省力。但在日常生活中,大眾也可利用DeepFace Lab、FaceApp等軟件輕易的修改人臉、聲音,這就使有心者不法利用,偽造假新聞、假圖像、假影片,以此欺詐牟利,甚至偽造大眾身邊親友肖像要求轉賬。民眾在接收資訊時一定要再三小心,以免成為不法分子的目標,若無法以肉眼判斷真偽,可使用網上各類偵測工具,雖說不能百分百確認真偽,但可作為一定的參考對象。

民眾若無法以肉眼判斷真偽,可使用deepware 工具協助偵測。【記者 楊澤恩/攝影】

民眾若無法以肉眼判斷真偽,可使用deepware 工具協助偵測。【記者 楊澤恩/攝影】